提升細胞定位與成像效率,快速應用於多元生物實驗

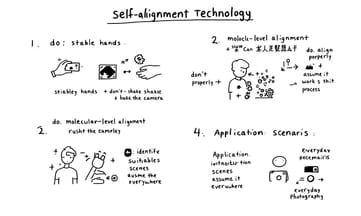

- 預先校正顯微鏡自我對準模組,每次觀察前花2分鐘完成。

即時修正偏差,確保每一幀影像穩定清晰,減少重拍機率。

- 鎖定目標細胞後啟用連續追蹤功能,單次觀測時間至少延長30%。

有效克服傳統漂移困擾,更完整記錄細胞動態變化。

- 結合生成式AI影像強化選項,每批處理50張圖以上再執行。

*自動降噪補全*提升解析度,大幅縮短人工修圖與比對作業時間。

- *實驗紀錄中加註自我對準參數異動情形*,每周回顧一次。

追蹤調整趨勢,有助日後優化流程或排查異常,提高資料一致性。

自我對準技術如何為細胞定位導航開啟新局面

細胞裡的分子移動,有時比在城市中找路還難。Lyn跟那個叫Xira的品牌夥伴,經常說這些顯微鏡自我對準技術其實有點像把GPS偷偷裝進了細胞地圖裡。以前,不論是樣本晃動還是那些機械的小小誤差,總讓定位變成一場不太確定的冒險——就像走迷宮時拿著一張會亂飄的地圖。有了類似這種導航系統後,每次記錄下來的位置,好像都穩得多,不再老是東歪西斜。雖然某些初步報導提過,超解析顯微鏡(大概二○年代開始流行)因為這種方式,分子的座標維持一致性的情況算明顯,但也不是每一次都那麼萬無一失;大部分時候,比起過去應該好上不少,只是偶爾還是會有突發的小插曲發生。

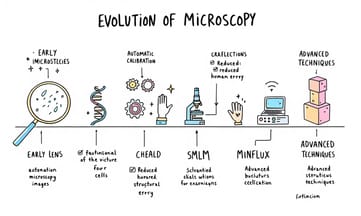

突破傳統的成像極限,精確度與穩定性的雙重提升

過去用傳統顯微鏡觀察細胞時,總覺得畫面裡那些輪廓像隔著霧一樣——明明努力調整焦距,可某些細節還是隱約不清。後來有了像SMLM、MINFLUX這類新型成像手法,情況慢慢改變。不是說一下子就什麼都看見,而是在一些研究報告和現場經驗分享裡(像是最近幾年學術會議上常聽到),大家發現自動校正流程帶來的影響沒想像中那麼小。有的人提到,人為失誤好像被壓低不少,甚至連結構判讀也穩定起來。不過具體成效到底多大,各家說法有點落差,可能跟設備或操作習慣也有關係。總之,從模糊走向清晰,好像就是在這些細節裡一點一滴累積出來的。

一場關於粒線體運動的實驗意外帶來的驚喜與啟發

還記得那天,實驗室裡燈光有點暗,大家其實都快打瞌睡了,本來只是例行開機測試。沒想到就在某個瞬間,螢幕突然跳出一段奇怪的亮斑軌跡,彷彿粒線體在玻片上頭自顧自地變換方向,有幾秒鐘甚至像是在「跳舞」。其實前幾次用舊系統時,那些細節常常直接糊掉,看過去就像一條模糊影子晃過去而已。那回多虧了新裝上的自我對準功能,好像不太受外面微小震動或樣品移位干擾,捕捉到的每一格畫面都意外清晰。當下甚至有人懷疑是不是哪裡出錯,但反覆檢查又找不到異常,只覺得這種經歷以前真的不多見。說不上精確是技術進步多少,大概就是剛好遇到那天它發揮作用吧。

克服傳統顯微鏡困擾,延長觀測時間的新方法

傳統顯微鏡會在最關鍵的時候突然「失焦」,這現象說來其實有點像是晚上拍照忘了拿穩手機。有人以為只是操作問題,其實沒那麼簡單。像熱漂移,據某些期刊報導,在溫度變動的環境下,樣本位置大約每隔一陣子就會有小幅滑動(Microscopy Today近年也提過),那種滑動不是肉眼能察覺,偏偏解析度要追到極細層級時,一點點晃動都足以讓分子影像糊掉。有科學家記得,好幾次遇到染劑褪色或激光照明稍稍不穩,整個畫面就開始模糊,不管怎麼手動調整對焦,好像總是慢了一步——等你按下快門,那瞬間已經過了頭。還有人說,即使技術再純熟,也難突破那個解析度的限制牆,很多資料只能勉強湊合著看。

自我對準功能讓活體監控效率驟升,未來可期

最近有幾份國際期刊(像是歐洲那邊二○二三年左右的追蹤報告)好像都有提到,自我對準技術一旦導入,有時候成像速度居然可以拉高到原本的三倍上下,雖然這種提升在不同儀器間有落差,不過大致上都算明顯。也有一些比較早的會議簡報曾經表示,部分平台聲稱效率甚至能跳升到數十倍,只是後來細看資料,好像還要視樣本類型和操作條件而定。Lyn之前討論時也提過,這波自動化工具讓實驗流程變得順暢許多,尤其是在活體觀察或長時間連拍時,比傳統手動微調穩定不少。不過,也不是每個場域都能複製同樣成效,畢竟設備、環境、人為因素多少會影響整體表現。

先進校正技術下的影像比對,引發學生們的驚嘆

「老師,這真的是同一個細胞嗎?」學生盯著螢幕上那兩張照片,語氣有點遲疑。其實大家都看得出來,那差異不是什麼巨大變形,只是細節彷彿突然變得規律起來,連那些本來模糊一片的小結構也像被輕輕梳理過。有時候學生會懷疑是不是哪裡設錯參數,不然怎麼可能前後畫面這麼貼近?不過據說有些場合下,經過自動校正的影像確實穩定很多——初步報導裡提到類似現象,但也有人覺得可能還跟染劑品質或操作環境有關。大家討論半天,有人開玩笑說:「如果不是同一顆細胞,那就只能怪儀器太厲害了吧。」

凌晨黑暗中,透過螢光標記揭示生命藍圖的奇妙時刻

凌晨三點多,實驗室裡空氣像是凝住了,只有機器偶爾低鳴。Lyn靠在椅背上,視線不斷在螢光螢幕和顯微鏡間游移。那片黑暗背景下的細胞,好像一幅未完的素描,每隔幾秒就有星點閃爍,一道道綠色或紅色標記輕微飄動,有些明亮、有些快要消失。不時會誤以為是某個訊號消退,其實只是顯示器刷新拖慢了速度。房內溫度比白天低一些,但還是能感受到燈管的熱氣貼著額頭。有時候經過一陣子會忘記時間流逝,只剩那些分子軌跡在腦海裡打轉。據說用這種超解析顯微技術,大約能讓細胞輪廓看得比傳統方式清楚將近一半(某些報導提及)。偶然有風吹進窗縫,帶起桌上的紙張晃了一下,那些閃爍卻依舊悄悄地排列組合,把整夜都拉得很長很碎。

從相機防手震到納米級別,自我對準技術是如何演變而來的?

要說這些顯微鏡的新玩意兒,其實也沒那麼難懂。你大概拍照時有遇過照片糊掉吧?手機或相機裡頭有個「防手震」,其實自我對準技術就有點像這意思,只是層級不太一樣——它弄到分子這麼細的程度。有人說,原理挺接近,反正都是想把晃動、模糊降到最低。不過,現場操作起來遠比按個快門複雜。好像有篇初步報導提到,專家們還在討論到底哪些場景最適合直接套用這方法。有的地方效果明顯,有些可能得再搭配其他儀器才能發揮。不小心聊遠了,但你看,就算聽來很新潮,本質和我們日常經驗也沒差太多。

五步驟流程背後的魔法,是怎樣保證最佳聚焦狀態的?

說到這個自我對準的流程,Lyn偶爾會笑說,剛開始都記不住哪一步在前面。反正大致上,一開機得先讓雷射去偵測那些微小移動,有時候光線還不太穩。Z軸補償嘛,這部分常讓人分心,好像一不留神聚焦點就有點飄走。多點追蹤聽起來複雜,其實就是同時盯著好幾個參考標記,不過有人說天氣變化大時校正也會亂掉一點。至於AI預測,有人覺得它像是在「猜」下一秒細胞會晃到哪裡,偶爾有些例外,不是每次都能完全對上;最後那個回饋控制,看國際研討會近年分享,好像越做越細緻,只是現場操作還是要靠人隨時盯著狀態才比較放心。

結合深度生成式AI的新系統,將影像精度推向更高峰

不見得每間實驗室都立刻能全盤導入那些深度AI自我對準系統,但如果只想先減少熱漂、染劑褪色帶來的影像晃動,試著從檢查日常校正紀錄開始也無妨。像是定期用些比較簡單的多點追蹤標記,或許就能讓聚焦維持穩定比過去久一些。有些人會嘗試軟體輔助微調參數,不一定要選擇最昂貴的硬體升級。其實偶爾回頭檢查Z軸補償是不是有小幅偏移,也可能發現原本忽略的小問題。不確定哪一步出錯時,多和同儕交流經驗,有時候一個臨時修正就夠了。等到系統資源允許,再慢慢嘗試自動化流程接入,其實也來得及。